Anthropic, het bedrijf dat zichzelf profileert als de voorzichtige partij in AI, maakte in één week deze twee opvallende blunders.

Anthropic, het bedrijf dat zichzelf profileert als de voorzichtige partij in AI, maakte in één week twee opvallende blunders. De tweede: het per ongeluk publiceren van de broncode van Claude Code.

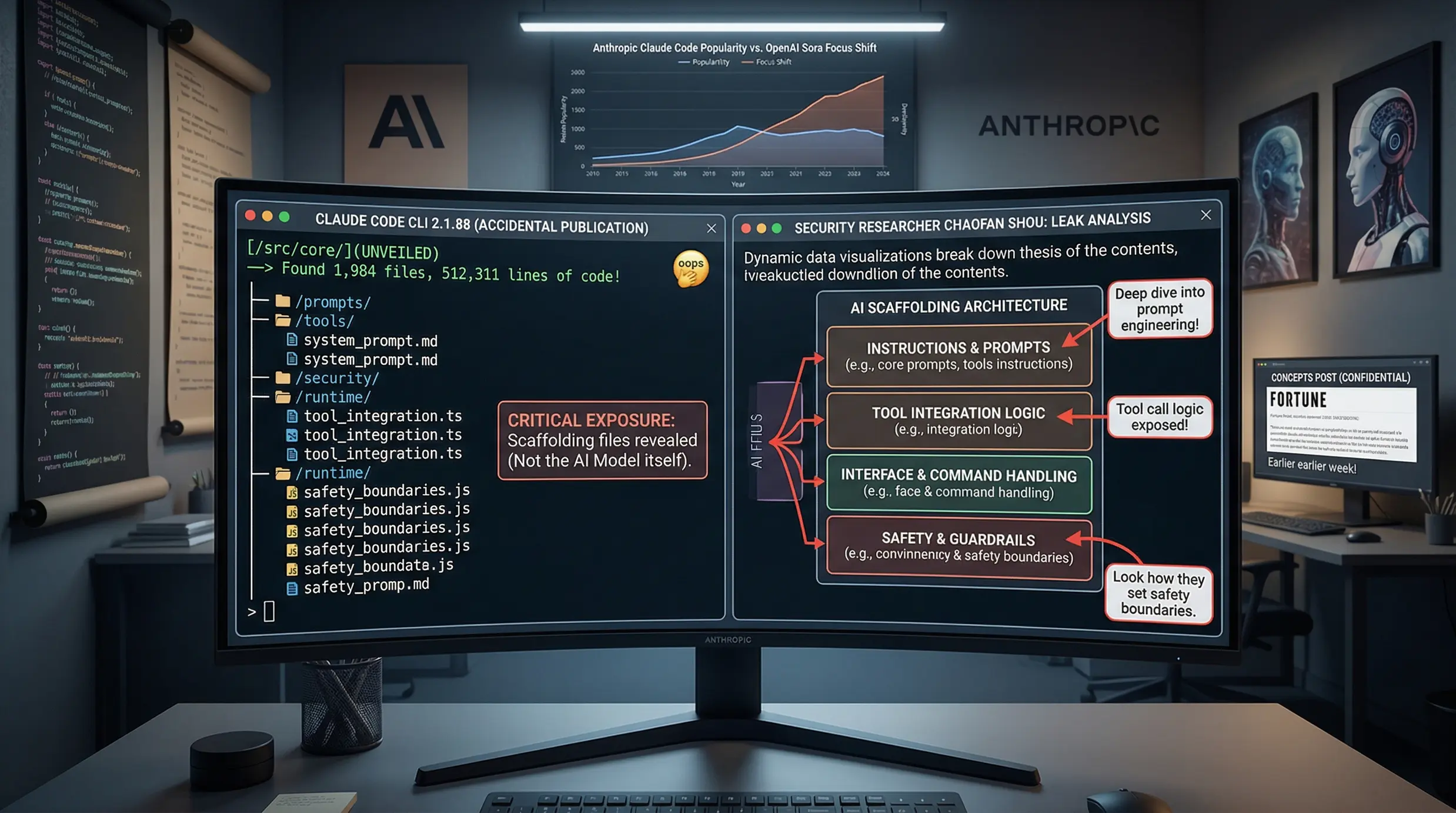

Bij het uitbrengen van versie 2.1.88 van Claude Code zat per ongeluk een bestand dat bijna 2.000 broncodebestanden en meer dan 512.000 regels code blootlegde. Claude Code is een command-line tool waarmee ontwikkelaars met Anthropics AI code kunnen schrijven en bewerken. Beveiligingsonderzoeker Chaofan Shou ontdekte het vrijwel direct en deelde zijn bevindingen op X.

Anthropic noemde het in een verklaring aan meerdere media "een verpakkingsfout door menselijke fout, geen beveiligingsinbreuk." Een opvallend nonchalante formulering voor een bedrijf dat juist bekendstaat om zijn nadruk op zorgvuldigheid en veiligheid.

Wat uitlekte was niet het onderliggende AI-model zelf, maar de softwarelaag eromheen, in vaktaal de scaffolding. Dat is de code die het model vertelt hoe het zich moet gedragen, welke tools het mag gebruiken en waar de grenzen liggen. Vergelijk het met de instructies en het gereedschap rond het model, niet het model zelf.

Ontwikkelaars begonnen vrijwel direct met gedetailleerde analyses. Eén van hen beschreef Claude Code als "een volwaardige ontwikkelaarservaring, niet zomaar een schil om een API." Dat geeft aan dat de gelekte code een serieuze architectuur blootlegt, waar concurrenten mogelijk van kunnen leren.

Het was niet de eerste misser die week. Eerder meldde Fortune dat Anthropic per ongeluk bijna 3.000 interne bestanden openbaar toegankelijk had gemaakt. Daaronder zat onder meer een conceptblogpost over een nieuw, nog niet aangekondigd model. Twee incidenten in korte tijd is pijnlijk voor elk techbedrijf, maar vooral voor een organisatie die zijn reputatie heeft gebouwd op verantwoord omgaan met krachtige technologie.

Claude Code is geen bijproduct. Het is een van Anthropics belangrijkste tools voor ontwikkelaars en wint snel aan populariteit. Volgens de Wall Street Journal stopte OpenAI zelfs zijn videogeneratietool Sora, zes maanden na de publieke lancering, mede om zijn focus te verleggen naar ontwikkelaars en zakelijke klanten. De groeiende populariteit van Claude Code zou daar een rol in hebben gespeeld.

Of het lek blijvende schade oplevert, is de vraag. Concurrenten kunnen de architectuur bestuderen, maar het AI-veld beweegt snel genoeg dat een voorsprong in tooling van korte duur kan zijn. Belangrijker is het signaal: als je als bedrijf claimt dat veiligheid en zorgvuldigheid in je DNA zitten, wegen dit soort fouten zwaarder. Niet omdat ze ongebruikelijk zijn in de software-industrie, maar omdat ze haaks staan op het verhaal dat Anthropic over zichzelf vertelt.